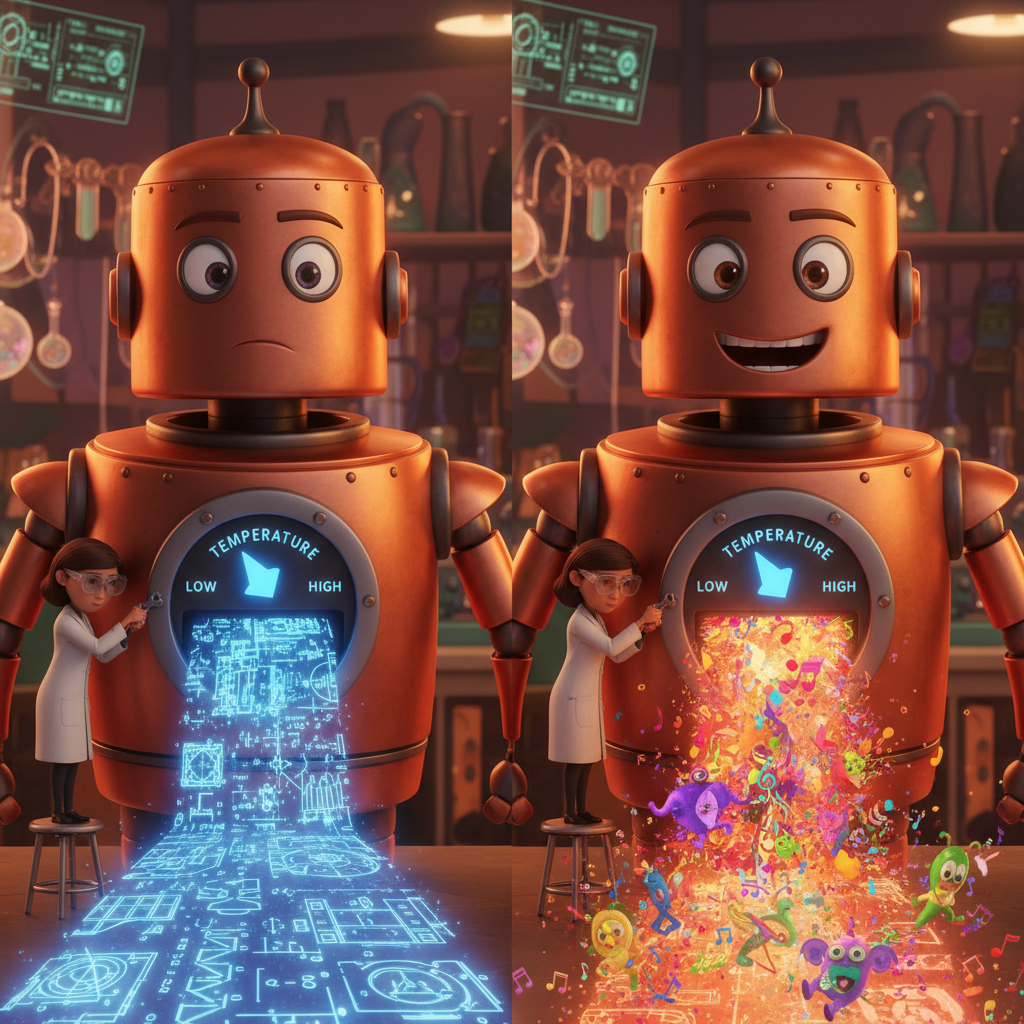

W świecie sztucznej inteligencji, gdzie każdy prompt jest zaproszeniem do dialogu, temperatura modeli AI odgrywa rolę dyrygenta. Ten z pozoru niewielki parametr ma fundamentalne znaczenie dla jakości i charakteru odpowiedzi generowanych przez chatbota. Wyobraź sobie pokrętło, które pozwala Ci swobodnie przełączać się między trybem maksymalnej kreatywności a bezkompromisową precyzją – to właśnie daje nam kontrola nad temperaturą.

Zrozumienie, jak manipulować tym parametrem, jest kluczowe dla każdego, kto chce wycisnąć maksimum z narzędzi takich jak ChatGPT, Claude czy Gemini. Niezależnie od tego, czy potrzebujesz burzy mózgów, generowania unikalnych pomysłów, czy wręcz przeciwnie, ścisłych faktów i logicznych podsumowań, odpowiednie ustawienie temperatury pozwoli Ci osiągnąć zamierzony cel. W tym artykule zanurzymy się w mechanizmy stojące za tym fascynującym zjawiskiem, pokażemy praktyczne zastosowania i nauczymy, jak świadomie korzystać z tej potężnej funkcji, by Twoje gotowe prompty AI były jeszcze skuteczniejsze.

Czym Jest Temperatura Modeli AI i Jak Dziala?

Temperatura modeli AI (ang. temperature) to parametr kontrolujący losowość i kreatywność w procesie generowania tekstu przez duże modele językowe (LLM). Działa on na zasadzie zmiany rozkładu prawdopodobieństwa wyboru kolejnego tokenu (słowa, części słowa lub znaku) w sekwencji. Kiedy model generuje odpowiedź, przewiduje, jaki będzie następny token, bazując na kontekście poprzednich. Robi to, przypisując każdemu możliwemu tokenowi pewne prawdopodobieństwo. Im wyższe prawdopodobieństwo, tym bardziej model „pewny” jest, że dany token jest najbardziej odpowiedni. Temperatura modyfikuje te prawdopodobieństwa, wpływając na to, jak ostro lub łagodnie model trzyma się najbardziej prawdopodobnych opcji.

Parametr temperatury zazwyczaj przyjmuje wartości od 0 do 2, choć zakres może się różnić w zależności od konkretnego modelu i implementacji. Wartość temperature=0 (lub bardzo bliska 0, np. 0.1) oznacza, że model zawsze wybierze token z najwyższym prawdopodobieństwem. To sprawia, że odpowiedzi są bardzo deterministyczne i powtarzalne, ale jednocześnie pozbawione kreatywności. Jeśli kilkukrotnie zadasz to samo pytanie z temperaturą ustawioną na 0, otrzymasz zazwyczaj identyczną lub bardzo podobną odpowiedź. Z kolei wyższe wartości temperatury (np. temperature=0.7 do 1.0 lub nawet 2.0) sprawiają, że model częściej wybiera tokeny z niższym prawdopodobieństwem. To wprowadza element losowości i różnorodności, czyniąc odpowiedzi bardziej kreatywnymi, oryginalnymi i mniej przewidywalnymi. Może to jednak również prowadzić do większej liczby halucynacji lub mniej spójnych odpowiedzi.

Losowosc w Generowaniu Odpowiedzi

Podstawą działania modeli językowych jest przewidywanie kolejnego elementu tekstu. To nic innego jak wybór słowa, które najlepiej pasuje do kontekstu. Na przykład, po zdaniu „Słońce świeciło jasno na…”, model może przewidzieć różne zakończenia: „niebie”, „polanie”, „wodzie”. Każde z tych słów ma przypisane prawdopodobieństwo. Bez temperatury, model po prostu wybierałby „niebie”, ponieważ ma ono zazwyczaj najwyższe prawdopodobieństwo w typowych tekstach. Gdy zwiększamy temperaturę, model staje się „mniej wybredny” i chętniej rozważa inne opcje, nawet jeśli ich prawdopodobieństwo jest nieco niższe. To sprawia, że teksty są bardziej zróżnicowane i mogą zawierać mniej oczywiste skojarzenia, co jest pożądane w zadaniach kreatywnych.

Jak Parametr Temperatury Wplywa na Dobor Tokenow

Matematycznie, temperatura modyfikuje tzw. logits, czyli surowe wyjścia z sieci neuronowej przed zastosowaniem funkcji softmax (która zamienia je na rozkład prawdopodobieństwa). Podzielenie logitów przez temperaturę przed softmaxem efektywnie spłaszcza lub zaostrza ten rozkład. Jeśli temperatura jest niska, wartości logitów są skalowane w górę, co sprawia, że różnice między prawdopodobieństwami stają się bardziej wyraźne, a token z najwyższym prawdopodobieństwem dominuje. Jeśli temperatura jest wysoka, logity są skalowane w dół, co zmniejsza różnice między prawdopodobieństwami i daje większą szansę na wybór rzadszych tokenów. To subtelne, ale potężne narzędzie, które pozwala programistom i użytkownikom dostosować zachowanie modelu do bardzo specyficznych potrzeb. Poznanie tych mechanizmów to podstawa zaawansowanego prompt engineeringu.

Wysoka Temperatura: Kiedy Postawic na Kreatywnosc i Oryginalnosc?

Ustawienie wysokiej temperatury (zazwyczaj od 0.7 do 1.0, a nawet 1.5-2.0 w niektórych modelach dla ekstremalnych efektów) jest idealne, gdy naszym celem jest pobudzenie kreatywności, generowanie nowych pomysłów, tworzenie unikalnych treści lub po prostu uzyskanie bardziej różnorodnych i oryginalnych odpowiedzi. W tym trybie model jest bardziej skłonny do „ryzykowania” i wybierania mniej oczywistych słów czy konstrukcji zdaniowych. Rezultaty mogą być zaskakujące, świeże i inspirujące, choć czasem mogą również odbiegać od faktów lub logiki. To właśnie w tym zakresie temperatury najlepiej sprawdzają się prompty kreatywne.

Przykłady zastosowań wysokiej temperatury obejmują: pisanie wierszy, scenariuszy, opowiadań, generowanie sloganów reklamowych, nazw produktów, pomysłów na kampanie marketingowe, a także wszelkie zadania wymagające myślenia out-of-the-box. Jeśli czujesz, że utknąłeś w rutynie i potrzebujesz świeżego spojrzenia, zwiększenie temperatury może okazać się Twoim najlepszym sprzymierzeńcem. Warto jednak pamiętać, że im wyższa temperatura, tym większe ryzyko, że model zacznie „halucynować”, czyli generować informacje, które są nieprawdziwe lub nie mają sensu. Dlatego zawsze warto weryfikować fakty po sesjach kreatywnych z wysoką temperaturą.

Burza Mozgow i Generowanie Pomyslow

Kiedy potrzebujesz szybkiej burzy mózgów i szeregu różnorodnych pomysłów, wysoka temperatura jest nieoceniona. Zamiast jednej, przewidywalnej odpowiedzi, otrzymasz wachlarz propozycji, które mogą posłużyć jako punkt wyjścia do dalszych analiz. Na przykład, poproś model o 20 pomysłów na prezent dla osoby, która ma wszystko, lub o 10 innowacyjnych rozwiązań dla problemu z recyklingiem plastiku. Z wyższą temperaturą model nie będzie się ograniczał do najbardziej typowych skojarzeń, ale spróbuje wyjść poza utarte schematy. To potężne narzędzie dla marketingowców, startupowców i każdego, kto potrzebuje rozwinąć koncepcje.

Tworzenie Tekstow Artystycznych i Opowiesci

Dla pisarzy, poetów czy twórców treści, wysoka temperatura to klucz do odblokowania nowych możliwości. Chcesz, aby chatbot napisał krótkie opowiadanie fantasy, wiersz o abstrakcyjnym temacie lub piosenkę w nietypowym stylu? Zwiększenie temperatury sprawi, że model będzie bardziej skłonny do użycia bogatszego słownictwa, metafor, nieoczekiwanych zwrotów akcji czy oryginalnych porównań. Pamiętaj, aby zawsze dopracować wygenerowany tekst własnym stylem i głosem, ale AI może dostarczyć doskonałej bazy lub inspiracji, która przełamie blokadę twórczą. Jest to szczególnie przydatne, gdy zależy nam na budowaniu unikalnego świata w opowiadaniach lub na tworzeniu angażujących dialogów.

Niska Temperatura: Maksymalna Precyzja i Konsekwencja

Niska temperatura (zazwyczaj od 0.0 do 0.5) to domyślne ustawienie dla wielu modeli i jest zalecana w sytuacjach, gdy precyzja, faktyczna poprawność, spójność i powtarzalność są absolutnie kluczowe. W tym trybie model jest bardzo konserwatywny, zawsze wybierając token z najwyższym prawdopodobieństwem, co minimalizuje losowość i ryzyko generowania błędnych informacji. Odpowiedzi będą bardziej przewidywalne, zwięzłe i ściśle trzymające się tematu. To idealne ustawienie dla zadań analitycznych, podsumowań i generowania faktów. To tutaj najlepiej sprawdzają się prompty biznesowe czy techniczne.

Przykładowe zastosowania niskiej temperatury to: pisanie artykułów naukowych, podsumowywanie długich dokumentów, tłumaczenia tekstów, generowanie kodu programistycznego, rozwiązywanie problemów matematycznych, tworzenie raportów finansowych, czy odpowiadanie na pytania dotyczące konkretnych faktów. Wartość 0.0 gwarantuje najbardziej deterministyczne wyniki, ale może sprawić, że odpowiedzi będą nieco „robotyczne” lub mało elastyczne. Nieco wyższa niska temperatura, np. 0.2 lub 0.3, może wprowadzić minimalną różnorodność, jednocześnie utrzymując wysoką precyzję. Jest to niezbędne, gdy szukamy konkretnych informacji, a nie kreatywnych interpretacji.

Analiza Danych i Raporty

Podczas pracy z danymi, gdzie każdy szczegół ma znaczenie, niska temperatura jest Twoim sprzymierzeńcem. Poproś chatbota o analizę zbioru danych, wygenerowanie raportu finansowego, podsumowanie wyników ankiety, czy stworzenie listy kluczowych wniosków z dokumentu. Z niską temperaturą model będzie skupiał się na najbardziej prawdopodobnych i faktycznie poprawnych sformułowaniach, minimalizując ryzyko wprowadzających w błąd interpretacji. To gwarantuje, że otrzymane informacje będą wiarygodne i spójne z dostarczonymi danymi. To nieocenione narzędzie dla analityków i menedżerów, którzy potrzebują szybkich i precyzyjnych podsumowań.

Tlumaczenia i Streszczenia Tekstow

Precyzja jest najważniejsza również w tłumaczeniach i streszczeniach. Kiedy tłumaczysz dokumenty techniczne, prawne czy medyczne, nie ma miejsca na swobodne interpretacje. Niska temperatura sprawi, że model będzie dążył do jak najwierniejszego oddania sensu oryginału, unikając kreatywnych wariacji. Podobnie, podczas streszczania długiego artykułu lub książki, chcesz, aby model wyłapał najważniejsze informacje i przedstawił je w zwięzłej, ale dokładnej formie. W tym przypadku, kreatywność mogłaby prowadzić do pominięcia kluczowych punktów lub dodania nieistotnych detali, dlatego stabilność generowanych odpowiedzi jest priorytetem. Dla zachowania integralności informacji, niska temperatura jest tu kluczowa.

Optymalny Wybor Temperatury dla Roznych Zadan

Wybór odpowiedniej temperatury to często kwestia doświadczenia i eksperymentowania. Nie ma jednej „uniwersalnej” wartości, która pasuje do wszystkich zastosowań. Zamiast tego, należy świadomie dobierać ten parametr w zależności od specyfiki zadania i oczekiwanych rezultatów. Poniżej przedstawiamy ogólne wytyczne, które mogą pomóc w podjęciu decyzji, ale zawsze zachęcamy do testowania różnych wartości, aby znaleźć idealne dopasowanie do Twoich potrzeb.

Tabela: Rekomendowane Wartosci Temperatury dla Roznych Zadan

| Typ Zadania | Rekomendowana Temperatura | Opis |

| :----------------------- | :------------------------ | :--------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- |

| Generowanie kodu | 0.0 - 0.2 | Maksymalna precyzja i spójność. Minimalizuje błędy i nieoczekiwane konstrukcje. |

| Tłumaczenie tekstów | 0.0 - 0.3 | Wierność oryginałowi, unikanie swobodnych interpretacji. |

| Streszczenia i podsumowania | 0.1 - 0.4 | Koncentracja na kluczowych informacjach, zachowanie faktów. |

| Odpowiedzi na pytania faktograficzne | 0.0 - 0.3 | Dokładność i unikanie halucynacji. Idealne dla [prompty edukacyjne](/prompty/edukacja). |

| Pisanie artykułów (informacyjnych) | 0.3 - 0.6 | Balans między precyzją a płynnością i naturalnym stylem. |

| Generowanie pomysłów | 0.7 - 1.0 | Burza mózgów, różnorodność i oryginalność. |

| Pisanie opowiadań/wierszy | 0.8 - 1.2 | Wysoka kreatywność, nietypowe zwroty akcji, bogactwo języka. Czasem nawet 1.5 dla bardzo eksperymentalnych form. |

| Generowanie sloganów/haseł | 0.9 - 1.3 | Poszukiwanie chwytliwych i unikalnych fraz. |

Rekomendowane Wartosci dla Typowych Zastosowan

Jak widać w tabeli, zadania wymagające ścisłości, takie jak generowanie kodu czy tłumaczenia, najlepiej realizować przy temperaturze bliskiej 0. W miarę jak przechodzimy do zadań bardziej kreatywnych, takich jak pisanie opowiadań czy generowanie pomysłów, temperatura powinna rosnąć. Ważne jest, aby stopniowo zwiększać ten parametr i obserwować, jak zmienia się charakter odpowiedzi. Zbyt gwałtowne zmiany mogą prowadzić do nieprzewidywalnych wyników. Dla ogólnych zadań, takich jak pisanie e-maili czy tworzenie postów na social media, często optymalne są wartości pośrednie, np. 0.5 – 0.7, które zapewniają balans między naturalnością a wiarygodnością.

Eksperymentowanie i Dostosowywanie do Kontekstu

Najlepszym sposobem na opanowanie kontroli nad temperaturą jest aktywne eksperymentowanie. Zadawaj ten sam prompt z różnymi wartościami temperatury i porównuj odpowiedzi. Zauważysz, jak subtelne zmiany mogą całkowicie odmienić styl i treść generowanego tekstu. Pamiętaj również, że kontekst jest królem. Jeśli pracujesz nad wieloetapowym projektem, możesz zacząć od wysokiej temperatury, aby wygenerować szeroki zakres pomysłów, a następnie, gdy przejdziesz do fazy selekcji i dopracowywania, obniżyć ją, aby skupić się na precyzji i konsekwencji. Ta dynamiczna zmiana temperatury to cecha prompt engineeringu dla zaawansowanych użytkowników, którą warto doskonalić, aby w pełni wykorzystać potencjał modeli językowych.

Temperatura a Inne Parametry Modeli AI

Temperatura nie jest jedynym parametrem, który wpływa na proces generowania tekstu. Wiele zaawansowanych modeli językowych oferuje również inne opcje kontroli nad losowością i jakością odpowiedzi. Zrozumienie, jak te parametry współdziałają z temperaturą, jest kluczowe dla pełnego opanowania prompt engineeringu. Najpopularniejsze z nich to top-p (znany również jako nucleus sampling) i top-k.

Top-k sampling ogranicza wybór kolejnego tokenu do k najbardziej prawdopodobnych tokenów. Na przykład, jeśli top-k=10, model wybierze tylko spośród 10 najbardziej prawdopodobnych tokenów, ignorując wszystkie inne, nawet jeśli mają one pewne prawdopodobieństwo. Top-p sampling (nucleus sampling) jest nieco bardziej dynamiczny. Zamiast ustalać stałą liczbę k tokenów, top-p wybiera minimalny zestaw tokenów, których skumulowane prawdopodobieństwo przekracza określoną wartość p. Na przykład, jeśli top-p=0.9, model wybierze tokeny tak długo, aż ich łączne prawdopodobieństwo wyniesie 90%. Oznacza to, że może wybrać 3 tokeny w jednym przypadku i 15 w innym, w zależności od rozkładu prawdopodobieństwa.

Top-P, Top-K i Ich Wplyw na Generowanie Tekstu

Zarówno top-k, jak i top-p są używane do zmniejszenia liczby tokenów, z których model może wybierać, co pomaga zapobiegać generowaniu całkowicie nonsensownych lub nieistotnych odpowiedzi. Różnią się jednak sposobem selekcji. Top-k jest bardziej statyczne i może nie uwzględniać dynamiki rozkładu prawdopodobieństwa (np. jeśli 10. token ma bardzo niskie prawdopodobieństwo, a 11. ma już zerowe, to top-k=10 zadziała dobrze; ale jeśli od 10. do 20. tokeny mają podobne, niskie prawdopodobieństwo, top-k=10 może być zbyt restrykcyjne). Top-p jest bardziej adaptacyjne, dopasowując liczbę tokenów do „jądra” najbardziej prawdopodobnych opcji. Często top-p jest preferowane ze względu na swoją elastyczność.

Kiedy używasz temperatury, zazwyczaj powinieneś używać jej w połączeniu z top-p lub top-k, ale nie wszystkimi naraz, aby uniknąć konfliktów lub zbyt restrykcyjnego filtrowania. Typowo, jeśli używasz top-p (np. top-p=0.9), możesz ustawić temperaturę na niższą wartość (np. 0.7), aby wprowadzić odrobinę losowości do tego już przefiltrowanego zestawu tokenów. Jeśli ustawisz temperaturę na bardzo wysoką wartość, a top-p na bardzo niską, parametry mogą ze sobą kolidować, co utrudni przewidywanie wyników. Zawsze sprawdzaj dokumentację konkretnego modelu AI, ponieważ różne implementacje mogą mieć różne zalecenia.

Dlugosc Odpowiedzi i Inne Ustawienia

Oprócz temperatury, top-p i top-k, modele AI oferują również inne parametry, które wpływają na generowaną treść. Najważniejsze z nich to: max_tokens (lub max_length), który kontroluje maksymalną długość generowanej odpowiedzi. Ustawienie tego parametru jest kluczowe, aby zapobiec zbyt długim lub zbyt krótkim odpowiedziom. Frequency_penalty i presence_penalty to kolejne parametry, które pozwalają kontrolować tendencję modelu do powtarzania tych samych fraz lub tematów. Frequency_penalty obniża szanse na wybranie tokenów, które już wielokrotnie pojawiły się w tekście, podczas gdy presence_penalty karze tokeny, które pojawiły się już w tekście wejściowym. Te parametry, w połączeniu z odpowiednio dobraną temperaturą, dają użytkownikom potężne narzędzia do fine-tuningu zachowania AI, tworząc teksty zgodne z oczekiwaniami, pozbawione monotonii i powtórzeń. Pełne zrozumienie i kontrola tych ustawień to domena ekspertów od prompt engineeringu.

Jak Skutecznie Kontrolowac Temperature w Swoich Promptach?

Kontrola temperatury nie zawsze odbywa się bezpośrednio w samym prompcie. W większości interfejsów użytkownika, takich jak ChatGPT Playground, API OpenAI, Google AI Studio czy Hugging Face Transformers, temperatura jest osobnym parametrem konfiguracyjnym, który ustawia się poza głównym polem tekstowym promptu. Jest to kluczowa różnica, którą należy zrozumieć. Prompt określa co model ma zrobić, a temperatura (oraz inne parametry) określa jak ma to zrobić. Dlatego też, podczas pisania promptu, nie ma sensu pisać np. Stwórz mi kreatywną historię z temperaturą 0.9 – samo kreatywną historię wystarczy, a wartość 0.9 ustawisz w dedykowanym do tego suwaku lub polu tekstowym.

Najlepszą praktyką jest używanie interfejsów, które umożliwiają łatwe dostosowywanie tych parametrów. W ChatGPT Plus czy Gemini Advanced, nie mamy bezpośredniego suwaka, ale możemy używać Custom Instructions lub w pewnym stopniu samego promptu, aby model zrozumiał, że ma być kreatywny lub precyzyjny. Jednak w środowiskach deweloperskich (API) lub bardziej zaawansowanych Playgroundach (np. OpenAI Playground), suwaki są standardem. Kluczem jest zawsze sprawdzenie, jakie opcje konfiguracji oferuje narzędzie, z którego korzystasz. Im lepsza kontrola nad parametrami, tym bardziej dopracowane odpowiedzi można uzyskać, szczególnie dla złożonych scenariuszy, które wymagają konkretnego balansu między twórczością a faktami.

Przyklady Promptow z Uzyciem Temperatury

Chociaż samej temperatury nie wpisujemy do promptu, to treść promptu powinna sugerować modelowi, jaki tryb działania jest pożądany, co w połączeniu z ustawioną temperaturą da najlepsze rezultaty. Oto kilka przykładów:

- Prompt (niska temp. 0.1-0.3):

Podsumuj kluczowe wnioski z załączonego raportu finansowego. Skup się wyłącznie na danych liczbowych i trendach, unikając subiektywnych interpretacji.(Ustawiamy niską temperaturę w interfejsie) - Prompt (wysoka temp. 0.8-1.0):

Napisz krótką, surrealistyczną opowieść o zegarze, który stracił poczucie czasu i zaczął podróżować w snach.(Ustawiamy wysoką temperaturę w interfejsie) - Prompt (średnia temp. 0.5-0.7):

Stwórz 5 pomysłów na kampanię marketingową dla nowego wegańskiego burgera, celującą w młodych dorosłych. Włącz elementy humorystyczne, ale zachowaj profesjonalny ton.(Ustawiamy średnią temperaturę w interfejsie)

Narzędzia i Interfejsy Umozliwiajace Kontrole

Większość platform oferujących dostęp do modeli AI (np. OpenAI API, Google AI Studio, Claude API, Hugging Face Transformers) zapewnia bezpośredni dostęp do parametru temperatury. W interfejsach graficznych (GUI) są to zazwyczaj suwaki, które pozwalają na płynną regulację. Dla programistów, parametr temperature jest jednym z argumentów funkcji odpowiedzialnej za generowanie tekstu. Nawet popularne narzędzia jak [prompty do ChatGPT](/prompty/chatgpt) w wersji płatnej, choć nie eksponują suwaka, w pewnym stopniu dostosowują wewnętrzne parametry na podstawie Custom Instructions użytkownika. Warto zawsze sprawdzić opcje „zaawansowane” lub „developer settings” w wybranym narzędziu, aby odkryć pełen zakres dostępnych kontroli i upewnić się, że wykorzystujemy potencjał AI w pełni. Poszukaj opcji takich jak "Creative mode" czy "Precise mode" w popularnych chatbotach - często są one niczym innym, jak prekonfigurowanymi ustawieniami temperatury.

Powiazane prompty

Jeżeli temat temperatury modeli AI Cię zainteresował i chcesz pogłębić swoją wiedzę oraz praktykę, sprawdź nasze gotowe prompty:

- Prompty kreatywne — idealne do generowania pomysłów, pisania opowiadań i innych zadań wymagających wysokiej temperatury.

- Prompty biznesowe — szablony do raportów, analiz i prezentacji, gdzie liczy się precyzja (niska temperatura).

- Prompty edukacyjne — gotowe instrukcje do nauki, weryfikacji faktów i tworzenia materiałów dydaktycznych, wymagające stabilnych odpowiedzi.

- Blog o AI i prompt engineering — znajdziesz tu więcej artykułów na temat zaawansowanych technik pracy z AI.

Podsumowanie

Temperatura modeli AI to jeden z najbardziej wpływowych, a jednocześnie często niedocenianych parametrów w interakcji z dużymi modelami językowymi. To właśnie ona decyduje, czy otrzymasz odpowiedź pełną kreatywnego rozmachu, czy też suchy i precyzyjny fakt. Zrozumienie mechanizmów stojących za tym parametrem – jak wpływa na losowość wyboru tokenów i jak współdziała z innymi ustawieniami, takimi jak top-p czy top-k – jest absolutnie kluczowe dla każdego, kto chce efektywnie wykorzystywać potencjał sztucznej inteligencji. Umiejętne dostosowanie temperatury do specyfiki zadania pozwala na znaczące podniesienie jakości generowanych treści, niezależnie od tego, czy potrzebujesz burzy mózgów, czy dokładnej analizy danych. Pamiętaj, że kluczem jest eksperymentowanie i świadome podejście do każdego promptu, uwzględniając kontekst i oczekiwany rezultat. Mamy nadzieję, że ten artykuł rozjaśnił Ci działanie tego potężnego narzędzia i zachęcił do dalszych eksploracji. Kontroluj temperaturę, kontroluj AI! Zacznij już dziś!